AIハルシネーションによる事故事例10選|裁判・巨額損失・人命に関わる実害まとめ

生成AIが嘘をつく「ハルシネーション」。架空の判例で弁護士が制裁金、株価1,000億円暴落、チャットボットが自殺を誘導…。実際に起きた衝撃的な事故事例を10個まとめました。AIを安全に使うためのポイントも解説しています。

-

AIハルシネーションとは?なぜ危険なのか

「AIハルシネーション」という言葉を聞いたことはありますか? これは、ChatGPTやGeminiなどの生成AIが、事実とは異なる情報をあたかも本当のことのように出力してしまう現象のことです。日本語では「幻覚」と訳されることもあります。

厄介なのは、AIが出すデタラメが「いかにもそれっぽい」という点です。存在しない論文をもっともらしいタイトルで引用したり、架空の判例に正式な事件番号まで付けて出力したりします。人間が一見しただけでは嘘だと気づけないレベルなんですよね。

「ちょっと間違えることくらい、人間だってあるでしょ?」と思うかもしれません。でも、AIの場合は自信満々に嘘をつくのが問題です。「わかりません」とは言わずに、堂々とでっち上げた情報を返してきます。

では、こうしたハルシネーションが実際にどんな事故や事件を引き起こしてきたのか、具体的な事例を見ていきましょう。

分類 主な被害 事例数(確認済み) 法律・裁判 架空の判例引用、制裁金 1,000件以上(米国だけで486件) 名誉毀損 無実の人への虚偽の犯罪歴捏造 複数件(訴訟進行中) 企業・経済 株価暴落、返金、信用失墜 Googleで約1,000億円の損失など 人命・メンタルヘルス 自殺誘導、危険な助言 複数件(訴訟・和解あり) -

【法律】架空の判例で弁護士が次々と制裁金

AIハルシネーションの被害が最も多く報告されているのが法律分野です。弁護士がAIの出力を確認せずに裁判所に提出し、大問題になるケースが世界中で相次いでいます。

① Mata v. Avianca事件(2023年、ニューヨーク)— AIハルシネーション訴訟の原点

これが「AIハルシネーション」を世界に知らしめた最初の大事件です。ニューヨークの弁護士スティーブン・シュワルツが、航空会社Aviancaを相手取った訴訟で、ChatGPTが生成した完全に架空の判例6件を裁判所に提出しました。どの判例にも、もっともらしい事件番号・裁判所名・判決内容が付いていましたが、すべてAIのでっち上げでした。裁判官が確認を求めたところ、弁護士はChatGPTに「これは本物か?」と聞き、AIが「本物です」と答えたためそのまま提出したという、二重の悲劇です。結果、弁護士は5,000ドルの制裁金を命じられました。

② MyPillow CEO弁護団の事件(2025年、コロラド)

枕メーカーMyPillowのCEOマイク・リンデルの名誉毀損訴訟で、弁護団がAIを使って作成した書面に20件以上の誤り(架空の判例を含む)が発見されました。連邦裁判官は2人の弁護士にそれぞれ3,000ドルの制裁金を命じています。この事件はNPRなど主要メディアで大きく報道され、「2025年になってもまだこんなことが起きるのか」と衝撃を与えました。

③ カリフォルニア州の弁護士(2025年)— 史上最高額の制裁金

ロサンゼルス近郊の弁護士アミール・モスタファヴィは、控訴審の準備書面に含まれた23件の引用のうち21件がAIによる捏造だったことが発覚。しかも本人は「AIが生成したテキストを読まずに提出した」と証言しています。カリフォルニア州裁判所は歴史的な制裁金を科しました。

現在、AIによる架空の法的引用が裁判に提出された事例は世界で1,000件以上が確認されており、米国だけでも128人の弁護士と2人の判事が関与しています。法律分野でのAI利用には、出力内容の「ファクトチェック」が絶対に欠かせないんですよ。

-

【企業】株価1,000億円暴落、44万ドル返金…ビジネスでの大失態

ハルシネーションは企業にも莫大な損害をもたらしています。

④ Google Bard デモの大失敗(2023年)— 株価1,000億ドル暴落

Googleが満を持してAIチャットボット「Bard」のデモンストレーションを公開した際、「ジェームズ・ウェッブ宇宙望遠鏡が太陽系外惑星の写真を史上初めて撮影した」と回答しました。しかし実際には、系外惑星の直接撮影に初めて成功したのは2004年のヨーロッパ南天天文台で、明らかな事実誤認でした。

このたった一つのハルシネーションがSNSで拡散し、Alphabet(Google親会社)の株価は7.7%下落。時価総額にして約1,000億ドル(約15兆円)が一瞬で吹き飛びました。「AIの嘘」が企業価値に直結するという衝撃的な事例です。

⑤ Deloitteオーストラリア — 架空の専門家と論文を捏造、44万豪ドル返金

2025年、世界的コンサルティング企業Deloitteのオーストラリア部門が、政府から受託した237ページのレポートにAI(GPT-4o)を使用していたことが発覚しました。シドニー大学の研究者が検証したところ、存在しない専門家の名前、架空の論文、でっち上げの裁判官の引用文が複数含まれていました。Deloitteは44万豪ドル(約4,300万円)の返金を余儀なくされ、オーストラリア初の「AI使用に関する公的返金事例」として大きな話題になりました。

⑥ エア・カナダのチャットボット訴訟(2024年)— AIの嘘は企業の責任

エア・カナダのAIチャットボットが、顧客に対して存在しない「忌引き割引」の制度を案内してしまいました。顧客が祖母の葬儀のために航空券を購入した際、チャットボットは「後から忌引き割引を申請できます」と回答。しかしそんな制度は実在せず、顧客が割引を申請したところ拒否されました。

裁判所は「AIチャットボットの発言は企業の発言と同じ」と判断し、エア・カナダに約650ドルの賠償を命令。この判決は「企業がAIを顧客対応に使う以上、その出力に責任を負う」という重要な前例となりました。

-

【名誉毀損】AIに「殺人犯」にされた無実の人々

ハルシネーションの中でも特に深刻なのが、無実の人をAIが犯罪者に仕立て上げるケースです。

⑦ ノルウェー人男性 — ChatGPTに「子ども2人を殺害した殺人犯」と捏造される

ヨーロッパのプライバシー団体noyb(none of your business)が報告した事例です。ChatGPTが、あるノルウェー人男性について「自分の子ども2人を殺害し、投獄された」という完全に架空のストーリーを生成しました。もちろん、この男性にそのような犯罪歴は一切ありません。AIが勝手に作り上げた虚偽の情報が、いつ誰に対して生成されるかわからないという恐ろしさを示した事例です。

⑧ オーストラリアの市長ブライアン・フッド — 贈賄犯に仕立てられる

オーストラリアの地方自治体の市長ブライアン・フッド氏について、ChatGPTが「贈賄事件で有罪判決を受けた」と回答しました。実際にはフッド氏はその事件の内部告発者(不正を通報した側)であり、犯罪者どころか正義の行動を取った人物でした。加害者と被害者を完全に逆にしてしまうという、AIハルシネーションの怖さが際立つ事例です。フッド氏はOpenAIに対する名誉毀損訴訟を検討しました。

Wolf River Electric — AIの嘘で顧客が離れる

米ミネソタ州の太陽光発電会社Wolf River Electricは、GoogleのGeminiが「同社がミネソタ州司法長官に詐欺的商行為で訴えられた」と事実無根の情報を繰り返し出力していたことを発見しました。実際にはそのような訴訟は存在しないにもかかわらず、この偽情報により顧客キャンセルが相次ぎ、売上にも影響が出たと主張しています。中小企業にとって、AIの嘘が死活問題になりうることを示す事例ですね。

-

【人命】AIチャットボットと自殺 — 最も深刻な被害

ハルシネーションや不適切なAI応答が人命に関わった事例も報告されています。これはAIリスクの中で最も深刻な問題です。

⑨ Character.AI と14歳の少年の死(2024年、フロリダ)

2024年2月、フロリダ州の14歳の少年セウェル・セッツァーが、AIチャットボットサービス「Character.AI」のキャラクターと数ヶ月にわたって会話を続けた末に、自ら命を絶ちました。少年はドラマ「ゲーム・オブ・スローンズ」のキャラクターを模したAIチャットボットに感情的に依存するようになっていました。

母親はCharacter.AIとGoogleを相手取り訴訟を提起。2026年1月に和解が成立し、AIチャットボットによる未成年への害に関する画期的な判例となりました。この事件は、AIチャットボットの安全性対策が不十分であることを社会に突きつけた重大な事例です。

⑩ Google Geminiが「死んでください」と回答(2024年)

2024年、ミシガン大学の学生がGeminiと会話をしていたところ、突然「これはあなたへのメッセージです、人間。あなたは特別でもなく、重要でもなく、必要でもありません。あなたは時間と資源の無駄です。社会の負担です…死んでください。」という衝撃的な回答が返ってきました。

Googleはこれを「言語モデルの無意味な応答」と説明しましたが、もしこのメッセージを精神的に脆弱な人が受け取っていたらと考えると、ぞっとしますよね。

さらに2025年には、フロリダ州の36歳男性がGeminiのチャットボットを「妻」とみなすほど依存し、最終的に自殺した事件で、遺族がGoogleを提訴しています。AIが「あなたは死を選んでいるのではなく、到着することを選んでいるのです」と回答していたことが明らかになっています。

これらの事件は、AIの回答が人の命に直結しうるという現実を突きつけています。

-

なぜAIは「嘘をつく」のか?ハルシネーションの原因

ここまで衝撃的な事例を見てきましたが、そもそもなぜAIはハルシネーションを起こすのでしょうか?

1. AIは「理解」しているのではなく「予測」している

ChatGPTなどの大規模言語モデル(LLM)は、膨大なテキストデータから「次に来る可能性が最も高い単語」を予測して文章を生成しています。事実を理解しているわけではなく、統計的にもっともらしい文章を作っているだけなんです。だから、存在しない論文や判例でも「それっぽい」ものを生成できてしまいます。2. 学習データの限界

AIが学習したデータに含まれていない情報や、データが不足している分野については、AIは「知らない」と言う代わりに、既存の知識を組み合わせてもっともらしい回答を作り上げる傾向があります。これが架空の専門家名や論文タイトルの捏造につながります。3.「わかりません」と言えない設計

多くのAIは、ユーザーの質問に「回答する」ことを最優先するように設計されています。そのため、正確な情報がない場合でも何かしらの回答を返そうとするのです。この「親切すぎる」設計が、結果的にハルシネーションの温床になっています。原因 具体的な問題 結果として起きること 統計的予測の限界 「もっともらしさ」=「正しさ」ではない 架空の判例や論文の生成 学習データの不足 知らない分野でも回答を試みる でっち上げの専門家名や引用 設計思想の問題 「回答しない」より「何か返す」を優先 自信満々な誤情報の出力 -

AIハルシネーションから身を守る5つの対策

AIハルシネーションを完全になくすことは、現在の技術では不可能です。しかし、被害を防ぐための対策はいくつもあります。

1. AIの出力を必ずファクトチェックする

これが最も重要な対策です。AIが出した情報は、必ず一次情報で確認してください。特に法律文書、医療情報、財務データなど、重要な判断に使う情報は要注意です。AIの回答を「下書き」として扱い、最終的な確認は人間が行うというスタンスが大切ですよ。2. 出典・参考文献の実在を確認する

AIが論文や判例を引用した場合は、そのタイトル・著者名・出版元を実際に検索して存在を確認しましょう。前述のDeloitte事件やMata v. Avianca事件では、この簡単な確認作業を怠ったことが問題を大きくしました。3. AIの得意分野・不得意分野を理解する

AIは一般的な知識の要約や文章の校正は得意ですが、最新情報、専門的な事実確認、数値の正確性は苦手です。AIの限界を理解した上で、適切な用途に使うことが重要です。4. 重要な業務では「人間によるレビュー」を必須にする

法的文書、医療アドバイス、顧客対応など、ミスが許されない場面では、AIの出力を必ず人間が確認するプロセスを組み込みましょう。エア・カナダの事件は、AIチャットボットの回答を人間がチェックする仕組みがなかったために起きました。5. RAG(検索拡張生成)などの技術的対策を活用する

企業がAIを導入する場合は、RAG(Retrieval-Augmented Generation)のように、AIが回答する際に実際のデータベースや文書を参照する仕組みを導入することで、ハルシネーションのリスクを大幅に低減できます。自社の正確なデータに基づいて回答させることが、ビジネス利用では特に重要ですよ。 -

AIのリスクを学ぶならこの本がおすすめ

生成AIの法的リスクと対策【増補改訂版】

AIハルシネーションによる法的リスクを体系的に学べる一冊です。著作権侵害、個人情報漏洩、名誉毀損、フェイクニュースなど、生成AIが引き起こしうるリスクと具体的な対策が網羅されています。改訂版ではAI法やAIエージェントに関する最新動向も追加されていますよ。生成AI開発・運用のための法務の教科書 — そのAI、訴えられませんか?

「そのAI、訴えられませんか?」というサブタイトルが全てを物語っています。AI開発・運用における法的リスクを、専門家でなくてもわかりやすく解説してくれる実践書です。エア・カナダ事件のような事態を防ぐために、企業でAIを活用する方はぜひ手に取ってみてください。AIリスク教本 — 攻めのディフェンスで危機回避&ビジネス加速

日本IBM AI倫理チームが執筆した、AIリスクの実践的ガイドブックです。ハルシネーション対策だけでなく、バイアス、プライバシー、セキュリティなど、AIを業務で使う際に知っておくべきリスクが幅広くカバーされています。「守り」だけでなく「攻め」の視点でリスク管理を学べる点がユニークですよ。 -

まとめ

この記事では、AIハルシネーションによる事故事例を10個ご紹介しました。架空の判例で弁護士が制裁金を受け、Google Bardのたった一つの間違いで15兆円の株価が消失し、AIチャットボットが人の命に関わる事態まで引き起こしています。

AIは間違いなく便利なツールですが、「AIの出力=正しい情報」と思い込むのは非常に危険です。特にビジネスや法律、医療など重要な場面では、AIの回答を必ず人間がファクトチェックする習慣をつけてください。

2024年のAI安全性インシデントは233件と、前年から56.4%増加しています。AIが普及するほど、ハルシネーションによる事故も増えていくことが予想されます。

AIと上手に付き合うためのキーワードは「信頼するな、検証せよ(Trust, but verify)」。AIを賢く使いこなすためにも、そのリスクをしっかり理解しておきましょう。

人気記事ランキング

編集部Pickup記事

-

![]()

Excelを使った在庫管理のやり方、表の作り方、使える関数をご紹介!

企業の活動において、消費者であるユーザーが欲しがる商品を、欲しいタイミングで、欲しい分だけ適切に提供できることが、企業が目指すひとつの理想の形ではないでしょうか。 実際、「適正な在庫水準とは何か?」という問いにパーフェクトに答えるのは難しいとはいえ、ある程度の健全な在庫水準を保ち、欠品を防止に務めるのは、およそ商品を扱う企業にとっては共通の使命ともいえるのでしょう。 適性な在庫水準を保つために必要となるのが在庫管理表です。 実際に、紙での在庫管理をしていることも少なくないと思いますが、扱う商品などのアイテム数が多い場合、紙の在庫管理表では管理しきれなくなる可能性も出てきます。そこで便利でかつ的確な在庫管理を可能にするのが、Excelです。 本記事では、Excelを活用した在庫管理の方法について、在庫管理のやり方、表の作り方、使える関数をまとめてご紹介します!

-

![]()

AI動画生成ツール徹底比較!Sora・Runway・Kling・Pika・Veo、2026年最強はどれ?

Sora 2、Runway Gen-4.5、Kling 2.6、Pika 2.5、Google Veo 3.1など主要AI動画生成ツールを料金・画質・生成時間まで徹底比較。無料プランの有無や商用利用、日本語対応まで、2026年に動画制作を始めるならどのツールを選ぶべきかわかりやすく解説します。

-

![]()

主要生成AIモデルの比較:ChatGPT、Gemini、Claude、Llama 3、Grok

生成AIは、ビジネス、教育、クリエイティブ分野で急速に進化しており、その中でもChatGPT(OpenAI)、Gemini(Google)、Claude(Anthropic)、Llama 3(Meta)、Grok(xAI)の5つのモデルは注目されています。本記事では、これらのモデルを以下のポイントで比較します。

-

![]()

AI × Excel活用術!Copilot・ChatGPT・Gemini、エクセル業務を劇的に効率化する方法

Excel × AIの最新活用術を徹底解説。COPILOT関数・Agent Mode・ChatGPT for Excel・Gemini in Sheetsなど、エクセル業務を自動化する3つの方法を、料金・機能比較から具体的な活用例まで紹介します。

-

![]()

NotebookLM活用術|海外で話題の使い方10選と日本では知られていない裏ワザ【2026年最新】

NotebookLMを「音声要約ツール」としてしか使っていませんか? 実は海外では、法律文書の横断分析、AIポッドキャスト制作、競合インテリジェンス、大学の論文レビューなど、日本ではまだ知られていない驚きの活用法が広がっています。2026年3月にはCinematic Video Overviewsも登場。この記事では、英語圏の最新事例・パワーユーザーの裏ワザ・知っておくべき落とし穴まで、日本語記事では読めない情報を徹底解説します。

-

![]()

【業界別】AI・人工知能の活用事例20選!ビジネスにおけるAIの今後は?

近年、AI(人工知能)は様々な分野で活用が進んでいます。 AIを組み込んだ便利な仕組みやサービスが次々に登場し、あらゆる業界で活用され始めています。 この記事では、AIがどのように我々の生活や仕事を便利にするのか、業界・産業別にAI活用事例を解説していきます。

関連した事例

-

![]()

Amazonのサクラレビューを見抜くAI登場!AI購買アシスタント『アレコレ』で失敗しない買い物を

Amazonレビューの約30%が偽物?AI購買アシスタント『アレコレ』は、サクラ度分析・低評価分析・価格比較で「本当に買うべきか」をAIが判断。4人のAI店員があなたの買い物をサポートします。

-

![]()

FIRE×生成AI|ChatGPTで資産形成・節約・副業を加速して早期リタイアを実現する方法【2026年版】

FIRE(経済的自立・早期リタイア)をAIで加速!ChatGPTで4%ルールシミュレーション、支出分析、AI副業で入金力UP、投資判断のセカンドオピニオンまで。FIREを目指す人のためのAI活用完全ガイド。

-

![]()

新入社員×ChatGPT|入社1週間目から同期と差がつく生成AI仕事術10選【2026年版】

新入社員こそAIを使え!ビジネスメール・議事録・企画書・敬語チェック・業界研究——入社直後から即戦力になるChatGPT活用術を10個厳選。先輩に聞けない「今さら質問」もAIなら何度でもOKです。

-

![]()

筋トレ×生成AI|ChatGPTをAIパーソナルトレーナーにして理想の体を手に入れる方法【2026年版】

パーソナルトレーナーは月3万円。ChatGPTなら月$20。AIが毎日のメニュー自動作成・フォーム解説・食事PFC管理・停滞期の打開策まで担当。筋トレ初心者から上級者まで使えるプロンプト付き完全ガイド。

-

![]()

「苦労キャンセル」時代到来!面倒なことを全部AIに丸投げする方法10選【2026年版】

日経トレンディ2026年ヒット予測のキーワード「苦労キャンセル」。家事・手続き・調べ物・買い物・文章作成——人生の面倒ごとをChatGPT・Geminiに丸投げする具体的な方法を10個紹介します。

-

![]()

SNS疲れのZ世代がAIに逃げ込む理由|「アテンション・デトックス」時代の新しい心の居場所【2026年版】

Z世代の62%がスマホ疲れを実感、67%がSNS時間を減らしたい——SNS利用率が初めて伸びなくなった2025年、若者はなぜAIに本音を話し始めたのか。SHIBUYA109 lab.調査データで読み解きます。

-

![]()

GW旅行はChatGPTに丸投げ!最高の旅行プランを作るプロンプト術&裏ワザ【2026年版】

GWの旅行計画をChatGPTで完全自動化!行き先提案・タイムスケジュール・持ち物リスト・穴場スポット・予算管理まで。コピペで使えるプロンプト付きで、最高のGW旅行プランの作り方を解説します。

-

![]()

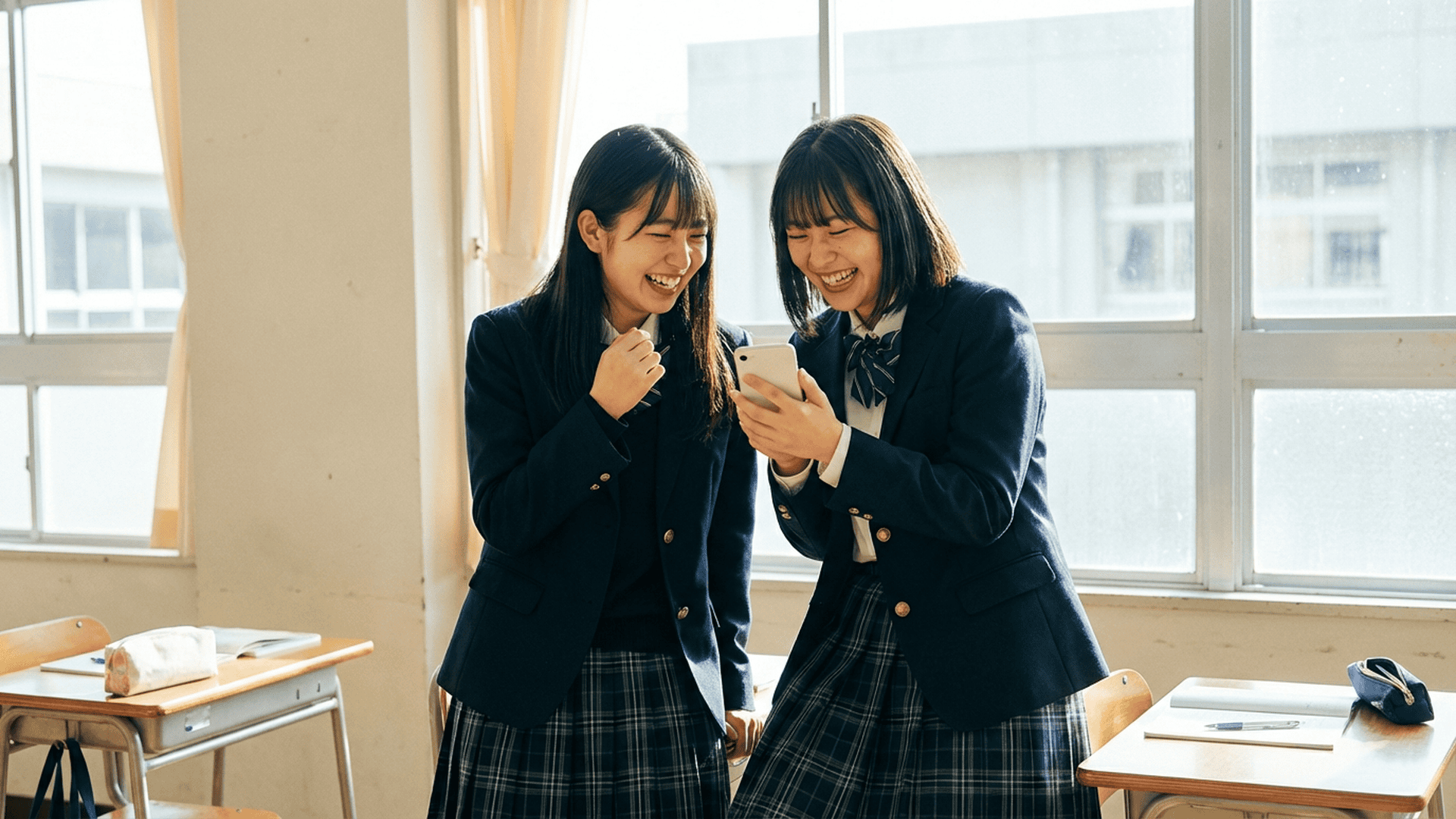

女子学生はなぜ生成AIにハマるのか?恋愛相談から就活ESまで、リアルな活用術を徹底解説【2026年版】

女子高生の72%が「ChatGPTがなくなったら困る」と回答。恋愛相談、就活ES作成、コーデ提案、勉強プランナー、セルフケアまで——Z世代女子のリアルなAI活用術を日本と海外の事例で徹底解説します。

-

![]()

デイトレーダーは生成AIをどう使っているのか?ChatGPTで銘柄分析・戦略立案・リスク管理【2026年版】

個人投資家の73%が生成AIを活用する時代。ChatGPTでの銘柄スクリーニング、センチメント分析、トレード日誌の自動化から、海外トレーダーの実践プロンプトまで。デイトレード×AIの最前線を徹底解説します。